Sie sehen sich die Dokumentation zu Apigee Edge an.

Sehen Sie sich die Apigee X-Dokumentation an. info

Mit Edge Microgateway können Sie die Apigee API-Verwaltung für Dienste bereitstellen, die in einem Kubernetes-Cluster ausgeführt werden. In diesem Thema wird erläutert, warum Sie Edge Microgateway in Kubernetes bereitstellen sollten, und wie Sie Edge Microgateway als Dienst in Kubernetes bereitstellen.

Anwendungsfall

In Kubernetes bereitgestellte Dienste stellen häufig APIs bereit, entweder für externe Nutzer oder für andere Dienste, die im Cluster ausgeführt werden.

In beiden Fällen müssen Sie ein wichtiges Problem lösen: Wie verwalten Sie diese APIs? Beispiel:

- Wie sichern Sie sie?

- Wie verwalten Sie den Traffic?

- Wie erhalten Sie Informationen zu Trafficmustern, Latenzen und Fehlern?

- Wie veröffentlichen Sie Ihre APIs, damit Entwickler sie finden und verwenden können?

Unabhängig davon, ob Sie vorhandene Dienste und APIs in den Kubernetes-Stack migrieren oder neue Dienste und APIs erstellen, bietet das Edge Microgateway eine einfache API-Verwaltung, einschließlich Sicherheit, Traffic-Management, Analysen, Veröffentlichung und mehr.

Edge Microgateway als Dienst ausführen

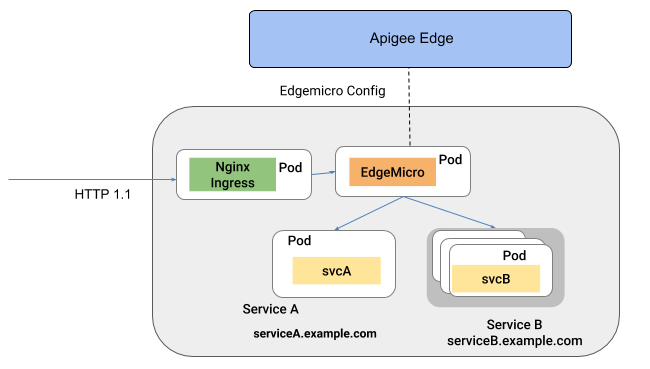

Wenn Edge Microgateway als Dienst in Kubernetes bereitgestellt wird, wird es in einem eigenen pod ausgeführt. In dieser Architektur fängt Edge Microgateway eingehende API-Aufrufe ab und leitet sie an einen oder mehrere Zieldienste weiter, die in anderen Pods ausgeführt werden. In dieser Konfiguration bietet das Edge Microgateway den anderen Diensten API-Verwaltungsfunktionen wie Sicherheit, Analysen, Traffic-Verwaltung und Richtlinienerzwingung.

Die folgende Abbildung zeigt die Architektur, in der Edge Microgateway als Dienst in einem Kubernetes-Cluster ausgeführt wird:

Weitere Informationen finden Sie unter Edge Microgateway als Dienst in Kubernetes bereitstellen.

Nächster Schritt

- Informationen zum Ausführen von Edge Microgateway als Dienst in Kubernetes finden Sie unter Edge Microgateway als Dienst in Kubernetes bereitstellen.