Edge pour Private Cloud v4.19.01

Ce document explique comment ajouter un centre de données (également appelé région) à des données existantes de sécurité.

Éléments à prendre en considération avant d'ajouter un centre de données

Avant d’installer ajouter un centre de données, vous devez comprendre comment configurer OpenLDAP, Serveurs ZooKeeper, Cassandra et Postgres dans les centres de données. Vous devez également vous assurer que les ports nécessaires sont ouverts entre les nœuds des deux centres de données.

- OpenLDAP

Chaque centre de données possède son propre serveur OpenLDAP configuré pour permettre la réplication. Lorsque vous installer le nouveau centre de données, vous devez configurer OpenLDAP pour utiliser la réplication et vous devez reconfigurer le serveur OpenLDAP dans le centre de données existant pour utiliser la réplication.

- ZooKeeper

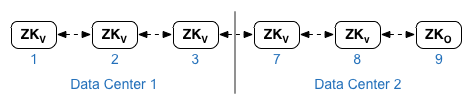

Pour la propriété

ZK_HOSTSde les deux centres de données, spécifiez les adresses IP ou les noms DNS de tous les nœuds ZooKeeper à partir des deux centres, dans le même ordre, et marquez tous les nœuds avec le modificateur ":observer". Les nœuds sans modificateur:observersont appelés "voters". Vous devez avoir un nombre nombre d'« votants » dans votre configuration.Dans cette topologie, l'hôte ZooKeeper sur l'hôte 9 est l'observateur:

Dans l'exemple de fichier de configuration présenté ci-dessous, le nœud 9 comporte le tag le modificateur

:observerafin d'avoir cinq votants: les nœuds 1, 2, 3, 7 et 8.Pour le

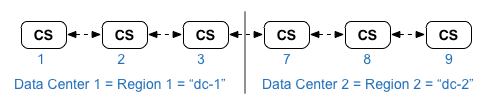

ZK_CLIENT_HOSTSpour chaque centre de données, spécifiez uniquement les adresses IP ou noms DNS de l'objet ZooKeeper du centre de données, dans le même ordre, pour tous les nœuds ZooKeeper des données. de sécurité. - Cassandra

Tous les centres de données doivent avoir le même nombre de nœuds Cassandra.

Dans le champ

CASS_HOSTSde chaque centre de données, veillez à spécifier toutes les adresses IP Cassandra (et non les noms DNS) pour les deux centres de données. Pour le centre de données 1, commencez par répertorier les nœuds Cassandra de ce centre de données. Pour les centres de données 2, listez d'abord les nœuds Cassandra de ce centre de données. Listez les nœuds Cassandra dans le même pour tous les nœuds Cassandra du centre de données.Tous les nœuds Cassandra doivent comporter un suffixe ':d,r'; Exemple : 'ip:1,1 = centre de données 1 et rack/zone de disponibilité 1 et 'ip:2,1 = le centre de données 2 et le rack/zone de disponibilité 1.

Exemple : "192.168.124.201:1,1 192.168.124.202:1,1 192.168.124.203:1,1 192.168.124.204:2,1 192.168.124.205:2,1 192.168.124.206:2,1"

Le premier nœud du rack/zone de disponibilité 1 de chaque centre de données sera utilisé comme source Google Cloud. Dans ce modèle de déploiement, la configuration de Cassandra se présente comme suit:

-

Postgres

Par défaut, Edge installe tous les nœuds Postgres en mode maître. Cependant, lorsque vous avez plusieurs centres de données, configurez les nœuds Postgres de sorte qu'ils utilisent la réplication de secours. Ainsi, si le le nœud maître tombe en panne, le nœud de secours peut continuer à acheminer le trafic du serveur. En règle générale, vous configurez le serveur Postgres maître dans un centre de données et le serveur de secours dans le second de sécurité.

Si le centre de données existant est déjà configuré pour avoir deux nœuds Postgres s'exécutant maître/veille, puis, dans le cadre de cette procédure, annuler l'enregistrement du nœud de secours existant et remplacez-le par un nœud de secours dans le nouveau centre de données.

Le tableau suivant indique la configuration de Postgres avant et après les deux scénarios:

Avant Après Nœud Postgres maître dans dc-1

Nœud Postgres maître dans dc-1

Nœud Postgres de secours dans dc-2

Nœud Postgres maître dans dc-1

Nœud Postgres de secours dans dc-1

Nœud Postgres maître dans dc-1

Nœud Postgres de secours dans dc-2

Annuler l'enregistrement de l'ancien nœud Postgres de secours dans dc-1

- Configuration requise pour les ports

Vous devez vous assurer que les ports nécessaires sont ouverts entre les nœuds des deux centres de données. Pour obtenir un schéma des ports, consultez la section Configuration requise pour les ports.

Mettre à jour le centre de données existant

Pour ajouter un centre de données, vous devez suivre les étapes d'installation et de configuration des nouvelles données centres de données, mais cela nécessite également que vous mettiez à jour les nœuds dans le centre de données d'origine. Ces sont nécessaires, car vous ajoutez des nœuds Cassandra et ZooKeeper qui doivent être accessibles au centre de données existant et que vous devez reconfigurer OpenLDAP pour utiliser la réplication.

Créer les fichiers de configuration

Vous trouverez ci-dessous les fichiers de configuration silencieuse pour les deux centres de données, où chaque dispose de six nœuds, comme indiqué dans la section Topologies d'installation. Notez que le fichier de configuration pour dc-1 ajoute des paramètres supplémentaires pour:

- Configurer OpenLDAP avec réplication sur deux nœuds OpenLDAP

- Ajoutez les nouveaux nœuds Cassandra et ZooKeeper de dc-2 au fichier de configuration de dc-1.

# Datacenter 1 IP1=IPorDNSnameOfNode1 IP2=IPorDNSnameOfNode2 IP3=IPorDNSnameOfNode3 IP7=IPorDNSnameOfNode7 IP8=IPorDNSnameOfNode8 IP9=IPorDNSnameOfNode9 HOSTIP=$(hostname -i) MSIP=$IP1 ADMIN_EMAIL=opdk@google.com APIGEE_ADMINPW=Secret123 LICENSE_FILE=/tmp/license.txt USE_LDAP_REMOTE_HOST=n LDAP_TYPE=2 LDAP_SID=1 LDAP_PEER=$IP7 APIGEE_LDAPPW=secret MP_POD=gateway-1 REGION=dc-1 ZK_HOSTS="$IP1 $IP2 $IP3 $IP7 $IP8 $IP9:observer" ZK_CLIENT_HOSTS="$IP1 $IP2 $IP3" # Must use IP addresses for CASS_HOSTS, not DNS names. CASS_HOSTS="$IP1:1,1 $IP2:1,1 $IP3:1,1 $IP7:2,1 $IP8:2,1 $IP9:2,1" SKIP_SMTP=n SMTPHOST=smtp.example.com SMTPUSER=smtp@example.com SMTPPASSWORD=smtppwd SMTPSSL=n SMTPPORT=25 SMTPMAILFROM="My Company <myco@company.com>" |

# Datacenter 2 IP1=IPorDNSnameOfNode1 IP2=IPorDNSnameOfNode2 IP3=IPorDNSnameOfNode3 IP7=IPorDNSnameOfNode7 IP8=IPorDNSnameOfNode8 IP9=IPorDNSnameOfNode9 HOSTIP=$(hostname -i) MSIP=$IP7 ADMIN_EMAIL=opdk@google.com APIGEE_ADMINPW=Secret123 LICENSE_FILE=/tmp/license.txt USE_LDAP_REMOTE_HOST=n LDAP_TYPE=2 LDAP_SID=2 LDAP_PEER=$IP1 APIGEE_LDAPPW=secret MP_POD=gateway-2 REGION=dc-2 ZK_HOSTS="$IP1 $IP2 $IP3 $IP7 $IP8 $IP9:observer" ZK_CLIENT_HOSTS="$IP7 $IP8 $IP9" # Must use IP addresses for CASS_HOSTS, not DNS names. CASS_HOSTS="$IP7:2,1 $IP8:2,1 $IP9:2,1 $IP1:1,1 $IP2:1,1 $IP3:1,1" SKIP_SMTP=n SMTPHOST=smtp.example.com SMTPUSER=smtp@example.com SMTPPASSWORD=smtppwd SMTPSSL=n SMTPPORT=25 SMTPMAILFROM="My Company <myco@company.com>" |

Ajouter un centre de données

Dans cette procédure, les centres de données sont nommés comme suit:

- dc-1: centre de données existant

- dc-2: le nouveau centre de données

Pour ajouter un centre de données:

- Sur le contrôleur dc-1, réexécutez le fichier setup.sh sur les nœuds Cassandra d'origine avec le nouveau fichier dc-1.

qui inclut les nœuds Cassandra de dc-2:

/opt/apigee/apigee-setup/bin/setup.sh -p ds -f configFile1

- Sur dc-1, réexécutez setup.sh sur le nœud du serveur de gestion:

/opt/apigee/apigee-setup/bin/setup.sh -p ms -f configFile1

- Sur dc-2, installez

apigee-setupsur tous les nœuds. Pour en savoir plus, consultez Installer l'utilitaire Edge de configuration Apigee. de l'utilisateur. - Sur dc-2, installez Cassandra et ZooKeeper sur les nœuds appropriés:

/opt/apigee/apigee-setup/bin/setup.sh -p ds -f configFile2

- Sur dc-2, exécutez la commande de recompilation sur tous les nœuds Cassandra, en spécifiant la

nom de la région de dc-1:

/opt/apigee/apigee-cassandra/bin/nodetool [-u username -pw password] -h cassIP rebuild dc-1

Vous ne devez transmettre votre nom d'utilisateur et votre mot de passe que si vous activé l'authentification JMX pour Cassandra ;

- Sur dc-2, installez le serveur de gestion sur le nœud approprié:

/opt/apigee/apigee-setup/bin/setup.sh -p ms -f configFile2

- Sur le nœud du serveur de gestion dans dc-2, installez

apigee-provision. qui installe l'utilitaireapigee-adminapi.sh:/opt/apigee/apigee-service/bin/apigee-service apigee-provision install

- Sur dc-2, installez les routes et les processeurs de messages sur les nœuds appropriés:

/opt/apigee/apigee-setup/bin/setup.sh -p rmp -f configFile2

- Sur dc-2, installez Qpid sur les nœuds appropriés:

/opt/apigee/apigee-setup/bin/setup.sh -p qs -f configFile2

- Sur dc-2, installez Postgres sur le nœud approprié:

/opt/apigee/apigee-setup/bin/setup.sh -p ps -f configFile2

- Configurez le maître/poste de secours Postgres pour les nœuds Postgres. Le nœud Postgres dans dc-1 est

maître, et le nœud Postgres dans dc-2 est le serveur de secours.

- Sur le nœud maître dans dc-1, modifiez le fichier de configuration en conséquence:

PG_MASTER=IPorDNSofDC1Master PG_STANDBY=IPorDNSofDC2Standby

- Activez la réplication sur le nouveau nœud maître:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql setup-replication-on-master -f configFIle

- Sur le nœud de secours dans dc-2, modifiez le fichier de configuration en conséquence:

PG_MASTER=IPorDNSofDC1Master PG_STANDBY=IPorDNSofDC2Standby

- Sur le nœud de secours dans dc-2, arrêtez le serveur, puis supprimez les

données Postgres existantes:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql stop

rm -rf /opt/apigee/data/apigee-postgresql/Si nécessaire, vous pouvez sauvegarder ces données avant de les supprimer.

- Configurez le nœud de secours dans dc-2:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql setup-replication-on-standby -f configFile

- Sur le nœud maître dans dc-1, modifiez le fichier de configuration en conséquence:

- Sur dc-1, mettez à jour la configuration des analyses et configurez les organisations.

- Sur le nœud du serveur de gestion de dc-1, récupérez l'UUID de Postgres

nœud:

apigee-adminapi.sh servers list -r dc-1 -p analytics -t postgres-server \ --admin adminEmail --pwd adminPword --host localhost

L'UUID apparaît à la fin des données renvoyées. Conservez cette valeur.

- Sur le nœud du serveur de gestion de dc-2, récupérez l'UUID de Postgres comme indiqué à l'étape précédente. Conservez cette valeur.

- Sur le nœud du serveur de gestion de dc-1, identifiez le

l'analyse et les groupes de consommateurs. Bon nombre des commandes ci-dessous nécessitent cette information.

Par défaut, le nom du groupe d'analyse est "axgroup-001" et celui du client est "consumer-group-001". Dans le fichier de configuration silencieuse d'une région, vous pouvez définir le nom du groupe d'analyses à l'aide de la propriété

AXGROUP.Si vous n'êtes pas sûr des noms des groupes de données analytiques et de consommateurs, utilisez le code suivant : pour les afficher:

apigee-adminapi.sh analytics groups list \ --admin adminEmail --pwd adminPword --host localhost

Cette commande renvoie le nom du groupe d'analyse dans le champ "Nom" et le groupe de consommateurs dans le champ "consumer-groups".

- Sur le nœud du serveur de gestion de dc-1, supprimez le fichier Postgres existant

du groupe d'analyse:

<ph type="x-smartling-placeholder">

- </ph>

- Supprimez le nœud Postgres de consumer-group:

apigee-adminapi.sh analytics groups consumer_groups datastores remove \ -g axgroup-001 -c consumer-group-001 -u UUID \ -Y --admin adminEmail --pwd adminPword --host localhost

Si dc-1 est configuré de sorte que deux nœuds Postgres s'exécutent dans en mode maître/veille, supprimez les deux:

apigee-adminapi.sh analytics groups consumer_groups datastores remove \ -g axgroup-001 -c consumer-group-001 -u "UUID_1,UUID_2" \ -Y --admin adminEmail --pwd adminPword --host localhost

- Supprimez le nœud Postgres du groupe d'analyse:

apigee-adminapi.sh analytics groups postgres_server remove \ -g axgroup-001 -u UUID -Y --admin adminEmail \ --pwd adminPword --host localhost

Si dc-1 est configuré pour avoir deux nœuds Postgres s'exécutant en mode maître/veille, supprimez les deux:

apigee-adminapi.sh analytics groups postgres_server \ remove -g axgroup-001 -u UUID1,UUID2 -Y --admin adminEmail \ --pwd adminPword --host localhost

- Supprimez le nœud Postgres de consumer-group:

- Sur le nœud du serveur de gestion de dc-1, ajoutez le nouveau nœud maître/de secours.

Serveurs Postgres vers le groupe d'analyse:

<ph type="x-smartling-placeholder">

- </ph>

- Ajoutez les deux serveurs Postgres au groupe d'analyse:

apigee-adminapi.sh analytics groups postgres_server \ add -g axgroup-001 -u "UUID_1,UUID_2" --admin adminEmail \ --pwd adminPword --host localhost

Ici, UUID_1 correspond au nœud Postgres maître dans dc-1, et UUID_2 correspond au système d'exploitation Postgres nœud dans dc-2.

- Ajoutez les serveurs PG au groupe "consumer-group" en tant que serveurs maître/reprise:

apigee-adminapi.sh analytics groups consumer_groups datastores \ add -g axgroup-001 -c consumer-group-001 -u "UUID_1,UUID_2" --admin adminEmail \ --pwd adminPword --host localhost

- Ajoutez les deux serveurs Postgres au groupe d'analyse:

- Ajoutez les serveurs Qpid de dc-2 au groupe d'analyse:

<ph type="x-smartling-placeholder">

- </ph>

- Sur le nœud du serveur de gestion de dc-1, récupérez les UUID du Qpid.

nœuds dans dc-2:

apigee-adminapi.sh servers list -r dc-2 -p central -t qpid-server \ --admin adminEmail --pwd adminPword --host localhost

Les UUID apparaissent à la fin des données renvoyées. Enregistrez ces valeurs.

- Sur le nœud Management Server de dc-1, ajoutez les nœuds Qpid au

analytics group (exécutez les deux commandes):

apigee-adminapi.sh analytics groups qpid_server \ add -g axgroup-001 -u "UUID_1" --admin adminEmail \ --pwd adminPword --host localhost

apigee-adminapi.sh analytics groups qpid_server \ add -g axgroup-001 -u "UUID_2" --admin adminEmail \ --pwd adminPword --host localhost - Sur le nœud Management Server de dc-1, ajoutez les nœuds Qpid au

grand groupe de consommateurs (exécutez les deux commandes):

apigee-adminapi.sh analytics groups consumer_groups consumers \ add -g axgroup-001 -c consumer-group-001 -u "UUID_1" \ --admin adminEmail --pwd adminPword --host localhost

apigee-adminapi.sh analytics groups consumer_groups consumers \ add -g axgroup-001 -c consumer-group-001 -u "UUID_2" \ --admin adminEmail --pwd adminPword --host localhost

- Sur le nœud du serveur de gestion de dc-1, récupérez les UUID du Qpid.

nœuds dans dc-2:

- Annulez l'enregistrement de l'ancien serveur de secours Postgres de dc-1 et supprimez-le:

<ph type="x-smartling-placeholder">

- </ph>

- Annulez l'enregistrement du serveur de secours Postgres dc-1 existant:

apigee-adminapi.sh servers deregister -u UUID -r dc-1 \ -p analytics -t postgres-server -Y --admin adminEmail \ --pwd adminPword --host localhost

Où UUID correspond à l'ancien nœud Postgres de secours dans dc-1.

- Supprimez le serveur de secours dc-1 Postgres existant:

apigee-adminapi.sh servers delete -u UUID \ --admin adminEmail --pwd adminPword --host localhost

- Annulez l'enregistrement du serveur de secours Postgres dc-1 existant:

- Sur le nœud du serveur de gestion de dc-1, récupérez l'UUID de Postgres

nœud:

- Mettez à jour les espaces de clés Cassandra avec un facteur de réplication correct pour les deux centres de données. Toi

cette étape n'est nécessaire qu'une seule fois sur n'importe quel serveur Cassandra de l'un ou l'autre des centres de données:

- Lancez l'utilitaire Cassandra

cqlsh:/opt/apigee/apigee-cassandra/bin/cqlsh cassandraIP

- Exécutez les commandes CQL suivantes au niveau de la commande "cqlsh>" pour définir la réplication

pour les espaces de clés Cassandra:

<ph type="x-smartling-placeholder">

- </ph>

ALTER KEYSPACE "identityzone" WITH replication = { 'class': 'NetworkTopologyStrategy', 'dc-1': '3','dc-2': '3' };ALTER KEYSPACE "system_traces" WITH replication = { 'class': 'NetworkTopologyStrategy', 'dc-1': '3','dc-2': '3' };- Affichez les espaces de clés à l'aide de la commande suivante:

select * from system.schema_keyspaces;

- Quittez

cqlsh:exit

- Lancez l'utilitaire Cassandra

- Exécutez la commande

nodetoolsuivante sur tous les nœuds Cassandra dans dc-1 pour libérer mémoire:/opt/apigee/apigee-cassandra/bin/nodetool [-u username -pw password] -h cassandraIP cleanup

Vous ne devez transmettre votre nom d'utilisateur et votre mot de passe que si vous activé l'authentification JMX pour Cassandra ;

- Pour chaque organisation et chaque environnement que vous souhaitez prendre en charge dans plusieurs centres de données:

<ph type="x-smartling-placeholder">

- </ph>

- Sur le nœud du serveur de gestion de dc-1, ajoutez le nouveau MP_POD au

Organisation:

apigee-adminapi.sh orgs pods add -o orgName -r dc-2 -p gateway-2 \ --admin adminEmail --pwd adminPword --host localhost

Où gateway-2 est le nom du pod de la passerelle, tel que défini par le MP_POD dans le fichier de configuration dc-2.

- Ajoutez les nouveaux processeurs de messages à l'organisation et à l'environnement:

<ph type="x-smartling-placeholder">

- </ph>

- Sur le nœud du serveur de gestion dc-2, récupérez les UUID du

Nœuds de processeur de messages dans dc-2:

apigee-adminapi.sh servers list -r dc-2 -p gateway-2 \ -t message-processor --admin adminEmail --pwd adminPword --host localhost

Les UUID apparaissent à la fin des données renvoyées. Enregistrez ces valeurs.

- Sur le nœud du serveur de gestion de dc-1, pour chaque processeur de messages

Dans dc-2, ajoutez le processeur de messages à un environnement pour l'organisation:

apigee-adminapi.sh orgs envs servers add -o orgName -e envName \ -u UUID --admin adminEmail --pwd adminPword --host localhost

- Sur le nœud du serveur de gestion dc-2, récupérez les UUID du

Nœuds de processeur de messages dans dc-2:

- Sur le nœud du serveur de gestion de dc-1, vérifiez l'organisation:

apigee-adminapi.sh orgs apis deployments -o orgName -a apiProxyName \ --admin adminEmail --pwd adminPword --host localhost

Où apiProxyName est le nom d'un proxy d'API déployé dans l'organisation.

- Sur le nœud du serveur de gestion de dc-1, ajoutez le nouveau MP_POD au

Organisation: