本文档介绍了如何向现有数据添加数据中心(也称为区域) 。

添加数据中心前的注意事项

在安装添加数据中心之前,您必须了解如何配置 OpenLDAP。 跨数据中心的 ZooKeeper、Cassandra 和 Postgres 服务器。您还必须确保 在两个数据中心的节点之间开放必要的端口。

- OpenLDAP

每个数据中心都有自己的 OpenLDAP 服务器,该服务器配置了复制功能。当您 您必须配置 OpenLDAP 才能使用复制功能, 请重新配置现有数据中心的 OpenLDAP 服务器以使用复制功能。

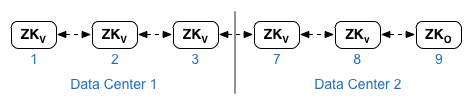

- ZooKeeper

对于

ZK_HOSTS属性: 为两个数据中心指定 IP 地址或 DNS 名称。 按相同的顺序排列中心,并使用“:observer”修饰符标记所有节点。 没有:observer修饰符的节点称为“voters”。您必须要有单数码 “投票者”人数。在此拓扑中,主机 9 上的 ZooKeeper 主机是观察器:

在如下所示的示例配置文件中,使用

:observer修饰符,以便您有五个投票者:节点 1、2、3、7 和 8。适合

ZK_CLIENT_HOSTS属性,请仅指定 ZooKeeper 的 IP 地址或 DNS 名称 按相同顺序排列数据中心内数据中的所有 ZooKeeper 节点的 。 - Cassandra

所有数据中心都必须拥有相同数量的 Cassandra 节点。

对于每个数据中心的

CASS_HOSTS,请确保指定所有 Cassandra IP 两个数据的地址(而非 DNS 名称) 。对于数据中心 1,首先列出该数据中心中的 Cassandra 节点。数据中心用 2,首先列出该数据中心中的 Cassandra 节点。在同一文件中列出 Cassandra 节点 所有 Cassandra 节点的订单。所有 Cassandra 节点都必须带有后缀“:d,r”;例如 ip:1,1 = 数据中心 1 和机架/可用区 1,ip:2,1 = 数据中心 2 和机架/可用区 1。

例如:"192.168.124.201:1,1 192.168.124.202:1,1 192.168.124.203:1,1 192.168.124.204:2,1 192.168.124.205:2,1 192.168.124.206:2,1"

每个数据中心机架/可用性区域 1 中的第一个节点将用作种子 服务器。在此部署模型中,Cassandra 设置将如下所示:

-

Postgres

默认情况下,Edge 会以主模式安装所有 Postgres 节点。但是,如果你有多个 您需要将 Postgres 节点配置为使用主备用复制模式, 主节点发生故障,备用节点可以继续服务器流量。通常,您需要 一个数据中心内的 Postgres 主服务器,第二个数据中的备用服务器 。

如果现有数据中心已配置为有两个 Postgres 节点在 主/备用模式,那么在此过程中,取消注册现有备用节点并 将其替换为新数据中心的备用节点。

下表显示了两者的 Postgres 配置之前和之后 场景:

之前 之后 dc-1 中的单个主 Postgres 节点

dc-1 中的 Postgres 主节点

dc-2 中的备用 Postgres 节点

dc-1 中的 Postgres 主节点

dc-1 中的备用 Postgres 节点

dc-1 中的 Postgres 主节点

dc-2 中的备用 Postgres 节点

取消注册 dc-1 中的旧备用 Postgres 节点

- 端口要求

您必须确保两个数据中心的节点之间必要的端口处于开放状态。 如需查看端口图,请参阅端口要求。

更新现有数据中心

添加数据中心时,您需要执行相关步骤来安装和配置新数据 但您还需要更新原始数据中心内的节点。这些 因为您要在新环境中添加新的 Cassandra 和 ZooKeeper 节点 并且您必须重新配置 通过 OpenLDAP 使用复制功能。

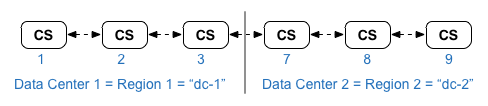

创建配置文件

下面显示了两个数据中心的静默配置文件,其中每个 如安装拓扑中所示,中心具有 6 个节点。请注意,dc-1 的配置文件会添加 其他设置来:

- 为 OpenLDAP 配置跨两个 OpenLDAP 节点的复制功能。

- 将 dc-2 中新的 Cassandra 和 ZooKeeper 节点添加到 dc-1 的配置文件中。

# Datacenter 1 IP1=IPorDNSnameOfNode1 IP2=IPorDNSnameOfNode2 IP3=IPorDNSnameOfNode3 IP7=IPorDNSnameOfNode7 IP8=IPorDNSnameOfNode8 IP9=IPorDNSnameOfNode9 HOSTIP=$(hostname -i) MSIP=$IP1 ADMIN_EMAIL=opdk@google.com APIGEE_ADMINPW=Secret123 LICENSE_FILE=/tmp/license.txt USE_LDAP_REMOTE_HOST=n LDAP_TYPE=2 LDAP_SID=1 LDAP_PEER=$IP7 APIGEE_LDAPPW=secret MP_POD=gateway-1 REGION=dc-1 ZK_HOSTS="$IP1 $IP2 $IP3 $IP7 $IP8 $IP9:observer" ZK_CLIENT_HOSTS="$IP1 $IP2 $IP3" # Must use IP addresses for CASS_HOSTS, not DNS names. CASS_HOSTS="$IP1:1,1 $IP2:1,1 $IP3:1,1 $IP7:2,1 $IP8:2,1 $IP9:2,1" SKIP_SMTP=n SMTPHOST=smtp.example.com SMTPUSER=smtp@example.com SMTPPASSWORD=smtppwd SMTPSSL=n SMTPPORT=25 SMTPMAILFROM="My Company <myco@company.com>" |

# Datacenter 2 IP1=IPorDNSnameOfNode1 IP2=IPorDNSnameOfNode2 IP3=IPorDNSnameOfNode3 IP7=IPorDNSnameOfNode7 IP8=IPorDNSnameOfNode8 IP9=IPorDNSnameOfNode9 HOSTIP=$(hostname -i) MSIP=$IP7 ADMIN_EMAIL=opdk@google.com APIGEE_ADMINPW=Secret123 LICENSE_FILE=/tmp/license.txt USE_LDAP_REMOTE_HOST=n LDAP_TYPE=2 LDAP_SID=2 LDAP_PEER=$IP1 APIGEE_LDAPPW=secret MP_POD=gateway-2 REGION=dc-2 ZK_HOSTS="$IP1 $IP2 $IP3 $IP7 $IP8 $IP9:observer" ZK_CLIENT_HOSTS="$IP7 $IP8 $IP9" # Must use IP addresses for CASS_HOSTS, not DNS names. CASS_HOSTS="$IP7:2,1 $IP8:2,1 $IP9:2,1 $IP1:1,1 $IP2:1,1 $IP3:1,1" SKIP_SMTP=n SMTPHOST=smtp.example.com SMTPUSER=smtp@example.com SMTPPASSWORD=smtppwd SMTPSSL=n SMTPPORT=25 SMTPMAILFROM="My Company <myco@company.com>" |

添加新的数据中心

请按照以下步骤添加新的数据中心。

在此过程中,数据中心 以下名称:

- dc-1:现有的数据中心

- dc-2:新数据中心

要添加新的数据中心,请执行以下操作:

- 在 dc-1 上,使用新 dc-1 在原始 Cassandra 节点上重新运行 setup.sh

配置文件,其中包含 dc-2 中的 Cassandra 节点:

/opt/apigee/apigee-setup/bin/setup.sh -p ds -f configFile1

- 在 dc-1 上,在管理服务器节点上重新运行 setup.sh:

/opt/apigee/apigee-setup/bin/setup.sh -p ms -f configFile1

- 在 dc-2 上,在所有节点上安装

apigee-setup。如需了解详情,请参阅安装 Edge apigee-setup 实用程序 信息。 - 在 dc-2 上,在相应的节点上安装 Cassandra 和 ZooKeeper:

/opt/apigee/apigee-setup/bin/setup.sh -p ds -f configFile2

- 在 dc-2 上,在所有 Cassandra 节点上运行重新构建命令,并指定

dc-1 的地区名称:

/opt/apigee/apigee-cassandra/bin/nodetool [-u username -pw password] -h cassIP rebuild dc-1

只有在以下情况下,您才需要传递用户名和密码: 为 Cassandra 启用了 JMX 身份验证。

- 在 dc-2 上,在适当的节点上安装管理服务器:

/opt/apigee/apigee-setup/bin/setup.sh -p ms -f configFile2

- 在 dc-2 中的管理服务器节点上,安装

apigee-provision。 该命令会安装apigee-adminapi.sh实用程序:/opt/apigee/apigee-service/bin/apigee-service apigee-provision install

- 在 dc-2 上,在适当的节点上安装路由和消息处理器:

/opt/apigee/apigee-setup/bin/setup.sh -p rmp -f configFile2

- 在 dc-2 上,在适当的节点上安装 Qpid:

/opt/apigee/apigee-setup/bin/setup.sh -p qs -f configFile2

- 在 dc-2 上,在相应的节点上安装 Postgres:

/opt/apigee/apigee-setup/bin/setup.sh -p ps -f configFile2

- 为 Postgres 节点设置 Postgres 主服务器/备用实例。dc-1 中的 Postgres 节点是

主服务器,且 dc-2 中的 Postgres 节点是备用服务器。

- 在 dc-1 的主节点上,修改配置文件以便进行以下设置:

PG_MASTER=IPorDNSofDC1Master PG_STANDBY=IPorDNSofDC2Standby

- 在新主实例上启用复制:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql setup-replication-on-master -f configFIle

- 在 dc-2 中的备用节点上,修改配置文件以进行以下设置:

PG_MASTER=IPorDNSofDC1Master PG_STANDBY=IPorDNSofDC2Standby

- 在 dc-2 中的备用节点上,停止服务器,然后删除任何

现有 Postgres 数据:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql stop

rm -rf /opt/apigee/data/apigee-postgresql/如有必要,您可以先备份这些数据,然后再将其删除。

- 在 dc-2 中配置备用节点:

/opt/apigee/apigee-service/bin/apigee-service apigee-postgresql setup-replication-on-standby -f configFile

- 在 dc-1 的主节点上,修改配置文件以便进行以下设置:

- 在 dc-1 上,更新分析配置并配置组织。

- 在 dc-1 的管理服务器节点上,获取 Postgres 的 UUID

节点:

apigee-adminapi.sh servers list -r dc-1 -p analytics -t postgres-server \ --admin adminEmail --pwd adminPword --host localhost

UUID 显示在返回的数据的末尾。保存该值。

- 在 dc-2 的管理服务器节点上,获取 Postgres 的 UUID 如上一步中所示。保存该值。

- 在 dc-1 的管理服务器节点上,确定

和消费者群体。下面的许多命令都需要这些信息。

默认情况下,分析群组的名称为“axgroup-001”,使用方的名称 群组为“consumer-group-001”在区域的静默配置文件中,您可以设置名称

AXGROUP属性对分析组进行分析。如果您不确定分析群组和消费者群组的名称,请使用以下 命令显示它们:

apigee-adminapi.sh analytics groups list \ --admin adminEmail --pwd adminPword --host localhost

此命令会在名称字段中返回分析群组名称,以及使用方群组 名称。

- 在 dc-1 的管理服务器节点上,移除现有的 Postgres

服务器:

<ph type="x-smartling-placeholder">

- </ph>

- 从使用方组中移除 Postgres 节点:

apigee-adminapi.sh analytics groups consumer_groups datastores remove \ -g axgroup-001 -c consumer-group-001 -u UUID \ -Y --admin adminEmail --pwd adminPword --host localhost

如果 dc-1 配置为有两个 Postgres 节点在 主/待机模式,请同时移除两者:

apigee-adminapi.sh analytics groups consumer_groups datastores remove \ -g axgroup-001 -c consumer-group-001 -u "UUID_1,UUID_2" \ -Y --admin adminEmail --pwd adminPword --host localhost

- 从分析组中移除 Postgres 节点:

apigee-adminapi.sh analytics groups postgres_server remove \ -g axgroup-001 -u UUID -Y --admin adminEmail \ --pwd adminPword --host localhost

如果 dc-1 配置为有两个以主/备用模式运行的 Postgres 节点, 移除两者:

apigee-adminapi.sh analytics groups postgres_server \ remove -g axgroup-001 -u UUID1,UUID2 -Y --admin adminEmail \ --pwd adminPword --host localhost

- 从使用方组中移除 Postgres 节点:

- 在 dc-1 的管理服务器节点上,添加新的主服务器/备用服务器

将 Postgres 服务器发送到分析组:

<ph type="x-smartling-placeholder">

- </ph>

- 将两个 Postgres 服务器添加到分析组:

apigee-adminapi.sh analytics groups postgres_server \ add -g axgroup-001 -u "UUID_1,UUID_2" --admin adminEmail \ --pwd adminPword --host localhost

Ehere UUID_1 对应于 dc-1,UUID_2 对应于备用 Postgres dc-2 中的节点。

- 将 PG 服务器作为主服务器/备用服务器添加到使用方群组:

apigee-adminapi.sh analytics groups consumer_groups datastores \ add -g axgroup-001 -c consumer-group-001 -u "UUID_1,UUID_2" --admin adminEmail \ --pwd adminPword --host localhost

- 将两个 Postgres 服务器添加到分析组:

- 将 Qpid 服务器从 dc-2 添加到分析组:

<ph type="x-smartling-placeholder">

- </ph>

- 在 dc-1 的管理服务器节点上,获取 Qpid 的 UUID

dc-2 中的节点:

apigee-adminapi.sh servers list -r dc-2 -p central -t qpid-server \ --admin adminEmail --pwd adminPword --host localhost

UUID 显示在返回的数据的末尾。保存这些值。

- 在 dc-1 的管理服务器节点上,将 Qpid 节点添加到

分析组(运行两个命令):

apigee-adminapi.sh analytics groups qpid_server \ add -g axgroup-001 -u "UUID_1" --admin adminEmail \ --pwd adminPword --host localhost

apigee-adminapi.sh analytics groups qpid_server \ add -g axgroup-001 -u "UUID_2" --admin adminEmail \ --pwd adminPword --host localhost - 在 dc-1 的管理服务器节点上,将 Qpid 节点添加到

使用方群组(运行两个命令):

apigee-adminapi.sh analytics groups consumer_groups consumers \ add -g axgroup-001 -c consumer-group-001 -u "UUID_1" \ --admin adminEmail --pwd adminPword --host localhost

apigee-adminapi.sh analytics groups consumer_groups consumers \ add -g axgroup-001 -c consumer-group-001 -u "UUID_2" \ --admin adminEmail --pwd adminPword --host localhost

- 在 dc-1 的管理服务器节点上,获取 Qpid 的 UUID

dc-2 中的节点:

- 取消注册并删除 dc-1 中的旧 Postgres 备用服务器:

<ph type="x-smartling-placeholder">

- </ph>

- 取消注册现有的 dc-1 Postgres 备用服务器:

apigee-adminapi.sh servers deregister -u UUID -r dc-1 \ -p analytics -t postgres-server -Y --admin adminEmail \ --pwd adminPword --host localhost

其中,UUID 是 dc-1 中的旧备用 Postgres 节点。

- 删除现有的 dc-1 Postgres 备用服务器:

apigee-adminapi.sh servers delete -u UUID \ --admin adminEmail --pwd adminPword --host localhost

- 取消注册现有的 dc-1 Postgres 备用服务器:

- 在 dc-1 的管理服务器节点上,获取 Postgres 的 UUID

节点:

- 使用正确的复制因子为两个数据中心更新 Cassandra 键空间。您

只需在任一数据中心的任何 Cassandra 服务器上运行此步骤一次即可:

- 启动 Cassandra

cqlsh实用程序:/opt/apigee/apigee-cassandra/bin/cqlsh cassandraIP

- 在“cqlsh>”处执行以下 CQL 命令提示设置复制

级别:

<ph type="x-smartling-placeholder">

- </ph>

ALTER KEYSPACE "identityzone" WITH replication = { 'class': 'NetworkTopologyStrategy', 'dc-1': '3','dc-2': '3' };ALTER KEYSPACE "system_traces" WITH replication = { 'class': 'NetworkTopologyStrategy', 'dc-1': '3','dc-2': '3' };- 使用以下命令查看键空间:

select * from system.schema_keyspaces;

- 退出

cqlsh:exit

- 启动 Cassandra

- 在 dc-1 中的所有 Cassandra 节点上运行以下

nodetool命令以释放空间 内存:/opt/apigee/apigee-cassandra/bin/nodetool [-u username -pw password] -h cassandraIP cleanup

只有在以下情况下,您才需要传递用户名和密码: 为 Cassandra 启用了 JMX 身份验证。

- 对于您希望跨数据中心支持的每个组织和每个环境:

<ph type="x-smartling-placeholder">

- </ph>

- 在 dc-1 的管理服务器节点上,将新的 MP_POD 添加到

组织:

apigee-adminapi.sh orgs pods add -o orgName -r dc-2 -p gateway-2 \ --admin adminEmail --pwd adminPword --host localhost

其中,gateway-2 是网关 Pod 的名称,由 MP_POD 属性。

- 将新的消息处理器添加到组织和环境中:

<ph type="x-smartling-placeholder">

- </ph>

- 在 dc-2 的管理服务器节点上,获取

dc-2 中的消息处理器节点:

apigee-adminapi.sh servers list -r dc-2 -p gateway-2 \ -t message-processor --admin adminEmail --pwd adminPword --host localhost

UUID 显示在返回的数据的末尾。保存这些值。

- 在 dc-1 的管理服务器节点上,对每个邮件处理器

在 dc-2 中,将消息处理器添加到组织的环境中:

apigee-adminapi.sh orgs envs servers add -o orgName -e envName \ -u UUID --admin adminEmail --pwd adminPword --host localhost

- 在 dc-2 的管理服务器节点上,获取

dc-2 中的消息处理器节点:

- 在 dc-1 的管理服务器节点上,检查组织:

apigee-adminapi.sh orgs apis deployments -o orgName -a apiProxyName \ --admin adminEmail --pwd adminPword --host localhost

其中,apiProxyName 是在组织中部署的 API 代理的名称。

- 在 dc-1 的管理服务器节点上,将新的 MP_POD 添加到

组织: